Este año no sólo se celebran elecciones nacionales en Estados Unidos, sino en más de 50 países de todo el mundo que representan a la mitad de la población mundial.

Aunque los retos son muchos, quizá ninguno sea mayor que la desinformación y la desinformación por inteligencia artificial (IA).

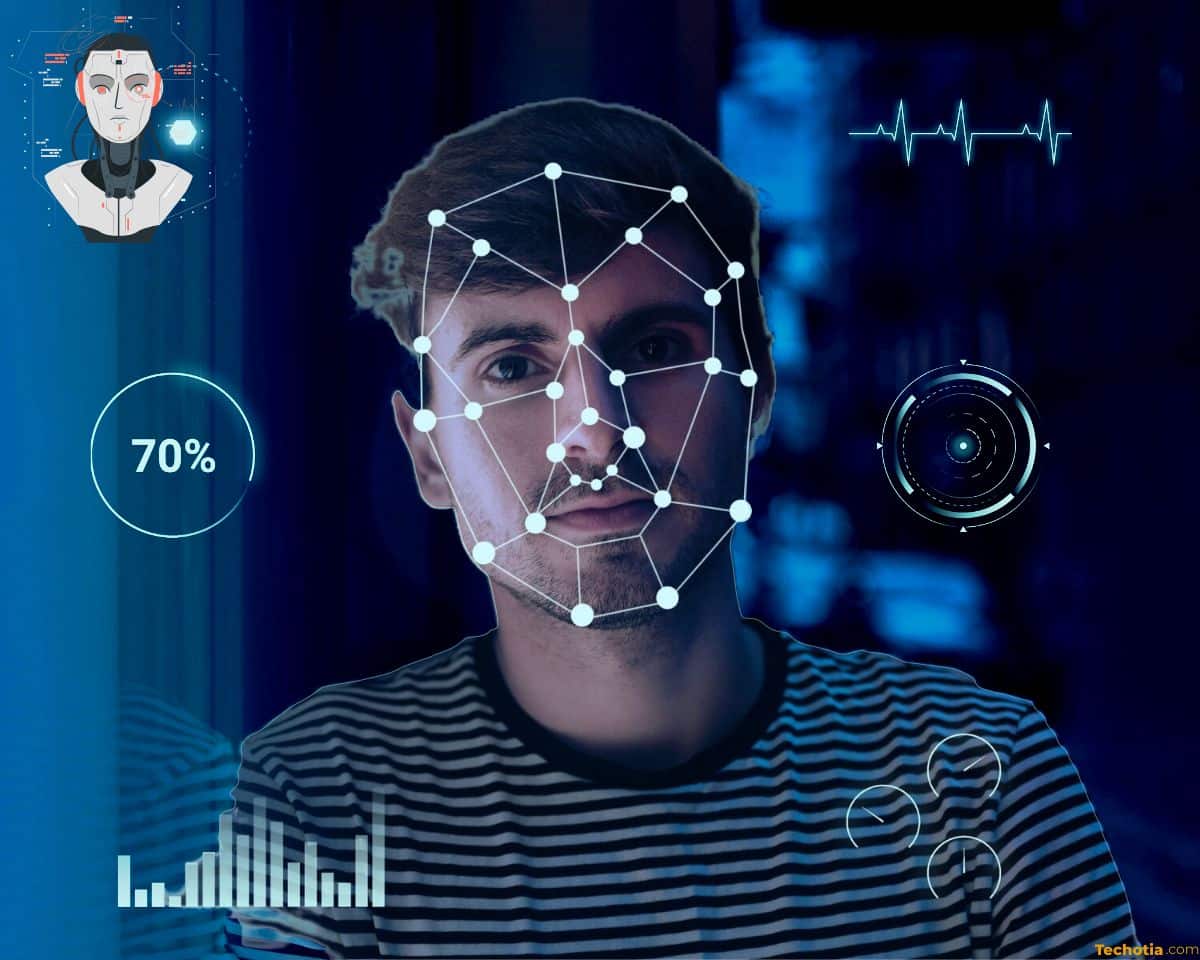

Esto incluye imágenes, vídeos y falsificaciones profundas, que suponen una gran amenaza, ya que podrían inducir a error a los votantes en vísperas de los comicios. Meta, la empresa matriz de Facebook, está tratando de contrarrestar esta amenaza.

Una encuesta del Foro Económico Mundial destaca que la desinformación y la desinformación impulsadas por la inteligencia artificial son las mayores amenazas mundiales a corto plazo.

Mark Zuckerberg afirma que Meta está intentando contrarrestar las campañas de desinformación generadas por IA de cara a las elecciones presidenciales estadounidenses de 2024.

Meta afirma que está trabajando para identificar y etiquetar las imágenes generadas por IA que se comparten en sus plataformas -Facebook, Instagram y Threads- y que han sido creadas por herramientas de terceros.

En los próximos meses, Meta empezará a añadir etiquetas generadas por IA a las imágenes creadas por herramientas de Google, Microsoft, OpenAI y Adobe, entre otras.

Meta ya añade una etiqueta que dice «imaginado con IA» a las imágenes creadas con su propia herramienta generadora de IA.

Ahora los usuarios pueden identificar fácilmente los contenidos de vídeo y audio generados con IA que comparten.

Nick Clegg, Presidente de Asuntos Globales de Meta, ha anunciado que el gigante tecnológico está colaborando con otras empresas líderes para establecer normas técnicas comunes.

Esto permitirá a los sistemas de Meta identificar las imágenes generadas por IA y creadas con sus herramientas. Meta decidió actuar después de que su propia junta de supervisión denunciara su incoherente política sobre medios manipulados.

Los especialistas en tecnología e información en línea han expresado su preocupación por la aparición de nuevos equipos de IA que podrían producir imágenes sorprendentemente realistas.

Junto con la capacidad de las redes sociales para compartir contenidos con rapidez, aumenta exponencialmente el riesgo de difusión de información falsa, lo que podría inducir a error a los votantes durante la temporada electoral.

Las amenazas de los contenidos falsos generados por IA van mucho más allá de las elecciones. El auge de las falsificaciones está calando en el mundo del espectáculo. Recientemente, aparecieron en las redes sociales falsificaciones pornográficas de la estrella del pop Taylor Swift, que enfurecieron a sus fans.

X, de Elon Musk, incluso bloqueó las búsquedas de Taylor Swift en la plataforma. Tom Cruz, Emily Blunt y Scarlet Johansson también se han enfrentado a esta amenaza. No sólo Hollywood, las falsificaciones profundas también han sido una amenaza para la seguridad internacional y cibernética.

En el último incidente, una multinacional de Hong Kong fue víctima de una sofisticada tecnología. Los empleados de la empresa fueron manipulados a través de una videoconferencia multipersonal, en la que todos los participantes, excepto la víctima, fueron creados utilizando una deep fake.

También se clonó digitalmente al director financiero de la empresa, y los autores realizaron una asombrosa estafa millonaria.

Aunque los contenidos generados por IA y la tecnología de falsificación profunda aún están en pañales, los retos y amenazas que plantean son descomunales. Aunque las empresas tecnológicas están tratando de combatir la información falsa y las falsificaciones profundas, superar a sus creadores podría ser una batalla muy larga.